Недавно мы рассказали, как экономим десятки тысяч рублей и часы команды с помощью нейросетей. В этой статье покажем, как создать в ИИ своего двойника для задач с видео.

У клона будет ваша мимика и голос — идеально для видеовизитки, инструкций, анонсов, подкастов-монологов и прочих дел в контенте. Буквально ваш видеоаватар.

Алексей Алексеев

экс-руководитель креативного кластера

Контекст

Мы захотели сделать аватара, который вместо меня участвовал бы в видеоподкастах-монологах. Мы хотели, чтобы он не только наговаривал какой-то текст на камеру, но и чтобы на него было приятно смотреть.

- реалистичное лицо;

- натуральный голос;

- губы попадают в речь;

- правдоподобные движения и мимика.

Короче говоря, чтобы не было нейросетевого кринжа — максимально живой аватар, которого не стыдно посадить перед камерой.

На всё у нас ушло четыре шага. Сейчас расскажем, что надо делать.

Настоящий или нейро?

Советы, которые помогут сделать видео и потом не перезаписывать его:

- сядьте за стол и положите на него руки, особо ими не двигайте;

- можете немного двигать плечами или головой, но без резких акцентов;

- убавьте эмоции и экспрессию, чтобы не путать ИИ;

- делайте заметные паузы между предложениями.

При первом тесте записали референс без пауз. Нейросеть не поняла, что делать, если нет аудио. В итоге аватар начал перебирать известные движения, конкретно у нас стал кивать головой.

Ещё советуем записать референс в студии — с поставленным светом, на хорошую камеру, контрастным однотонным фоном. Тогда выше шанс получить максимально качественный ролик, сможете его долго использовать.

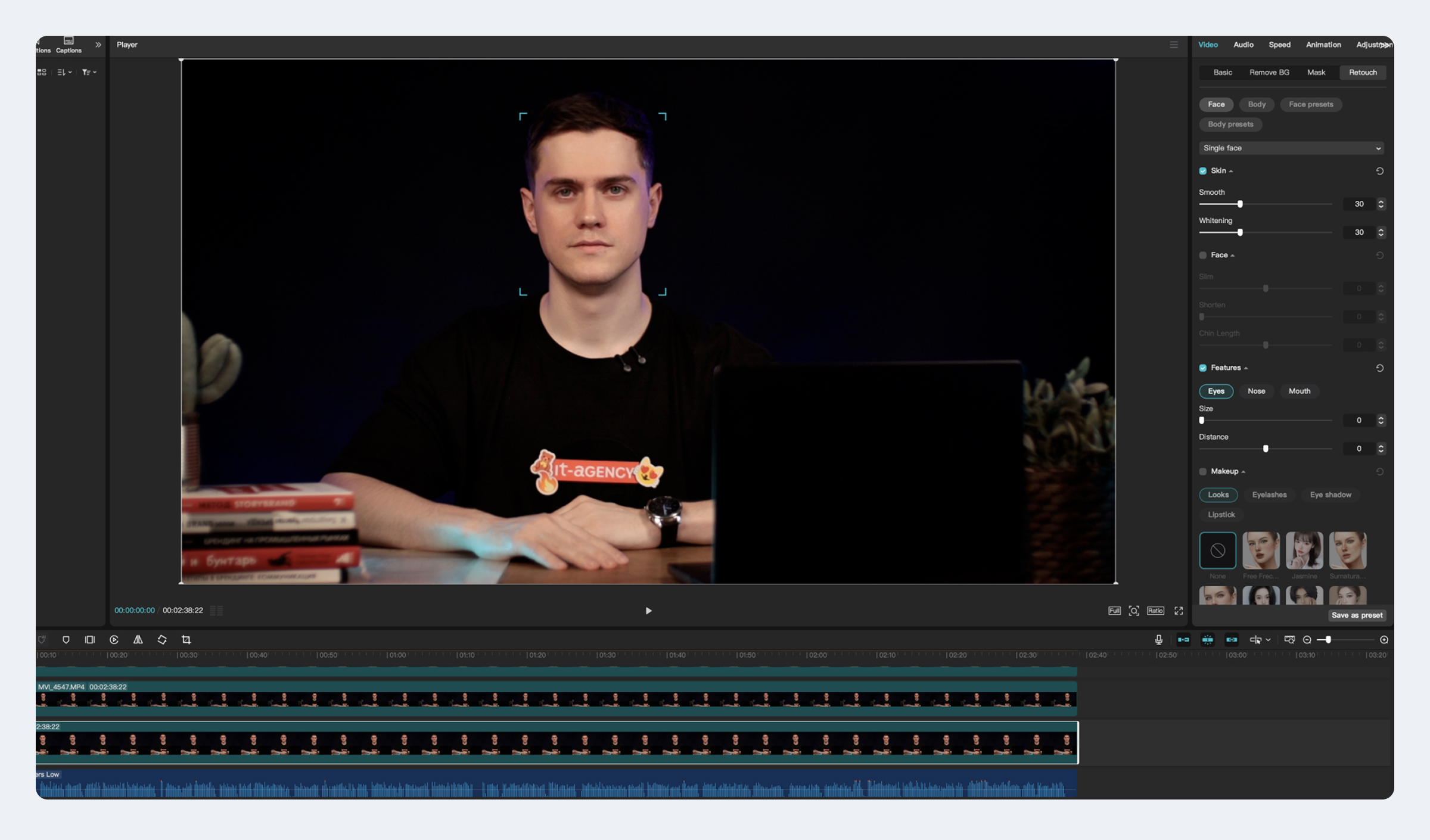

Шаг второй: обработка видео

Берём готовый референс и дорабатываем его в редакторе CapCut — улучшаем качество и убираем небольшие шероховатости лица.

Например, я сделал небольшую цветокоррекцию и осветлил лицо, ещё размыл черты, чтобы сбавить мешки под глазами :-) Сделали всё с помощью маски и инструмента Smoothing.

Это нужно не только, чтобы ваш аватар выглядел бодрее и свежее. Это тоже поможет нейросети удержать фокус на важных элементах клона, а не мешках под глазами.

Почему для задачи отлично подходит CapCut:

- он бесплатный, если у вас macOS;

- есть куча встроенных ИИ-инструментов, чтобы улучшить изображение;

- есть инструменты и маски, которые чистят звук от шумов, правят громкость, меняют тембр голоса и так далее.

Можно в одной программе как поправить картинку, так и убрать лишние шумы из аудиодорожки — бесплатно. Когда будете удовлетворены качеством референса, переходите к следующему шагу.

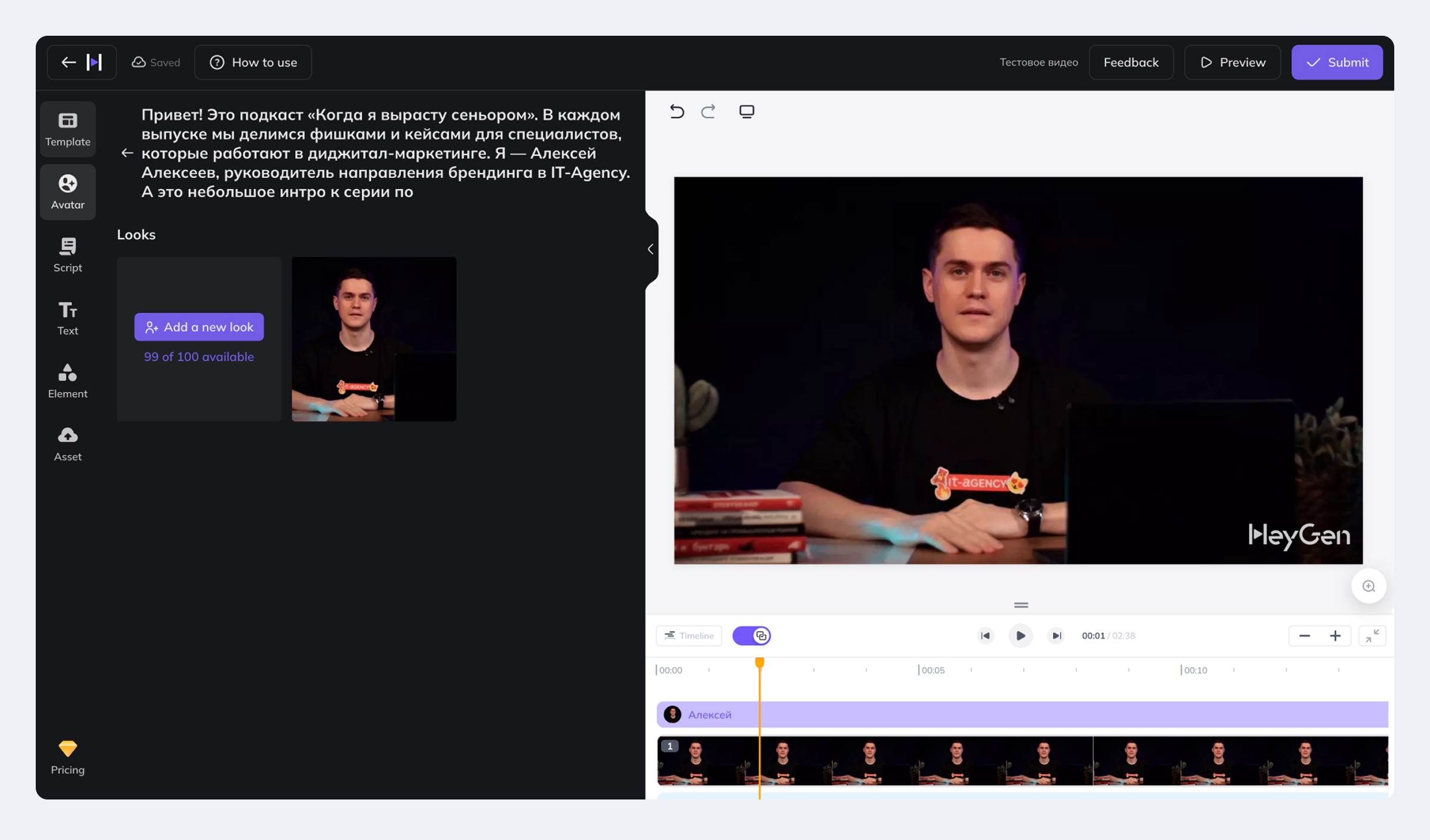

Шаг третий: обучаем нейросеть

Готовое видео загружаем в нейросеть HeyGen. Повторюсь, для обучения ИИ хватит 3-5 минут.

Если вы боитесь, что вашу личность украдут, чтобы сделать своего аватара — не бойтесь, в HeyGen так нельзя. Существуют различные Face Swap с наложением вашего лица на другого человека, но конкретно HeyGen такое просто не пропустит.

В любом случае, у HeyGen есть дополнительная система защиты личности.

Когда вы загрузите референс, нейросеть попросит вас снять видео с телефона на фронтальную камеру и зачитать текст, который она сгенерирует в этот момент. Так она проверит, вы ли являетесь тем человеком, который загрузил первое видео — соотнесёт загруженный и проверочные файлы.

После проверки открываем на боковой панели инструменты и добавляем туда наш текст, который хотим озвучить аватаром.

Кстати, для теста HeyGen мы взяли текст интро из подкаста «Когда я вырасту сеньором»

Готово, можете скачать сгенерированное видео, где нейросетевой аватар читает заготовленный текст вашим голосом.

На бесплатном аккаунте можно сделать одного клона и три видео продолжительностью до 30 секунд без FullHD + останется ватермарка HeyGen. Советуем сразу купить платную версию, чтобы получать ролики в высоком качестве и без ватермарок.

Недостаток такой генерации: нейросеть плохо считывает паузы в тексте и криво работает с эмоциями и акцентами. Чаще всего их приходится править вручную. Однако мы нашли гениальный в своей простоте лайфхак.

Вместо текста вы можете загрузить для обработки аудио. Включите диктофон на телефоне и проговорите текст, после чего отдайте этот файл нейросети.

Тогда HeyGen синхронизирует движение губ и мимику аватара с аудиодорожкой. Это не идеальное решение, но будет куда эффективнее, чем преобразование текста в голос.

Вот и всё, ваш ИИ-аватар готов сниматься в видеороликах и зачитывать тексты.

Да, в начале была нейросеть

Итог

На всё ушло 2-3 часа, теперь у меня есть собственный нейросетевой двойник, который может участвовать в подкастах, читать новости, небольшие лекции и инструкции, делать анонсы, приглашать на мероприятия и т.д.

Сейчас на подобные видео уходит не более 10 минут. Из расходов только оплата подписки на нейросеть, что в разы дешевле и эффективнее, чем аренда студии и многочасовые записи.

А ещё у ИИ-аватара не болит горло, он не кашляет и всегда хорошо выглядит.

Одни плюсы, тестируйте!

Статья написана по мотивам моего вебинара о том, как нейросети меняют digital.

Конспект вебинара «Как удалённо управлять контент-маркетингом, чтобы он давал результаты»

Конспект вебинара «Как удалённо управлять контент-маркетингом, чтобы он давал результаты» Лидогенерация в нейросетях. 9 вопросов, ответы на которые помогут получить лиды из ИИ

Лидогенерация в нейросетях. 9 вопросов, ответы на которые помогут получить лиды из ИИ Как наладить производство качественного контента в своей организации

Как наладить производство качественного контента в своей организации Кейс Mindbox: построили систему контент-маркетинга за 3,5 месяца

Кейс Mindbox: построили систему контент-маркетинга за 3,5 месяца